2026.02.11

生成AIのセキュリティ|中小企業が押さえるべきリスクと対策

ChatGPTで議事録をまとめたり、報告書の下書きを作ったり。生成AIは一度使うと手放せなくなるほど便利です。

ただ、便利さの裏にはリスクもあります。

☑入力した情報が外に漏れないか

☑知らないうちに著作権を侵害していないか

☑AIの回答をそのまま信じて大丈夫か

こうした不安を感じている方は少なくないはずです。

実際、ある会社で無料版のChatGPTで取引先の名前や金額をそのまま入力してしまっていた、という話を聞いたことがあります。悪気はまったくない。でも、これがどうなるかを知らないと、かなり危ない。

怖がって使わないのも損、知らずに使うのも危険。

【この記事でわかること】

中小企業が生成AIを安全に使うために押さえておきたい3つのリスク対策

☑情報漏洩対策

☑著作権侵害対策

☑ハルシネーション(AIのウソ)対策

についてわかりやすく解説します。

1. なぜ「情報漏洩」が起きるの?AIの仕組みをざっくり理解

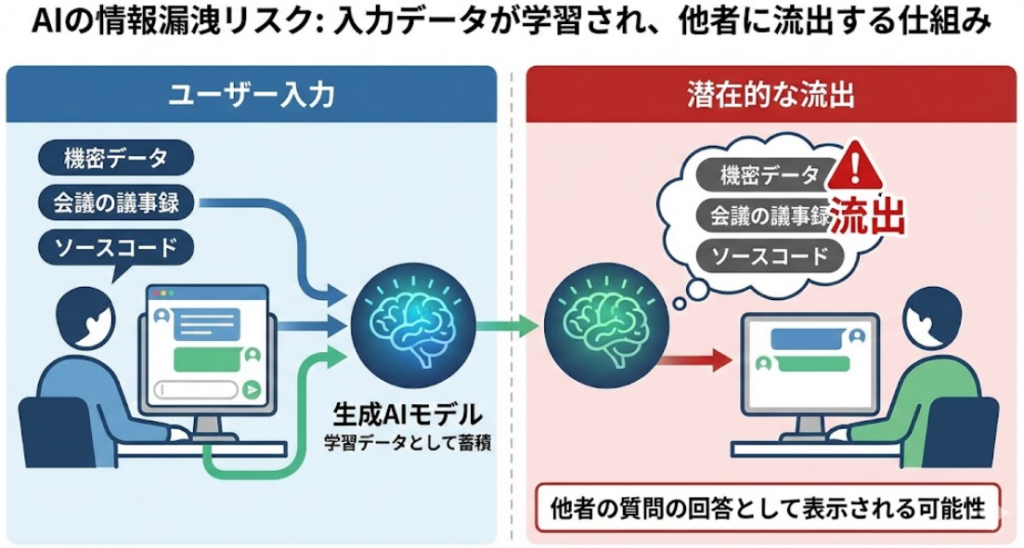

生成AIの最大のリスクは、入力した情報がAIの学習データに取り込まれてしまうことです。

ChatGPTのようなツールは、ユーザーとのやりとりを教材にして精度を上げていく仕組みになっています。つまり、あなたが入力した内容がAIの知識に組み込まれ、別の誰かが似た質問をしたときに、その情報が回答に含まれてしまう可能性があります。

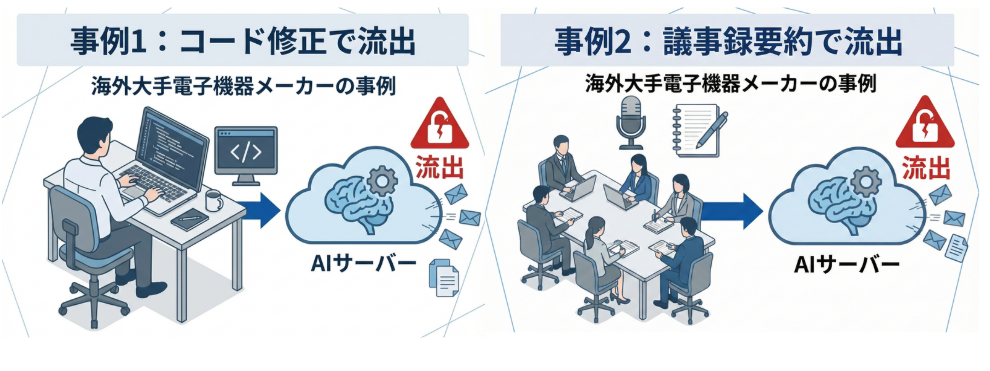

実は、世界的な大企業でも“うっかりミス”による漏洩が起きています…

大企業でもやらかしているのだから、「うちは小さい会社だから大丈夫」ということはありません。

むしろ、専任のIT担当がいない中小企業のほうが、一度漏れたときの対応が難しくなります。

情報漏洩が起きないようにするための2つの対策

①学習されない設定(オプトアウト)にする

ChatGPTなどの生成AIには、入力データを学習に使わせない設定があります。これを「オプトアウト」と呼びます。

ほとんどのツールでは、初期設定では学習される設定になっています。つまり、何も設定しなければ、入力した情報はAIの学習に使われてしまう。

業務で使う前に、必ず設定画面からオプトアウトしてください。

②法人向けの有料プランを契約する

法人プランでは、入力データを学習に使わないことが規約で保証されていることが多く、セキュリティ機能も強化されています。

社内で正式にAIを使うなら、コストはかかりますが、法人向けプランの契約をおすすめします。

それでもゼロにはならないリスク

法人プランを契約してオプトアウト設定をしても、リスクがゼロになるわけではありません。

以下の2つは頭に入れておく必要があります。

①サーバー側の不具合や攻撃

学習に使わない設定にしても、データはサービス提供者のサーバーに一時的に送信されます。バグやサイバー攻撃があれば、そこから漏れる可能性はゼロではありません。

②人的リスク

会社が法人プランを契約していても、社員が個人的に別のAIツールを業務に使ってしまうケース。普段使い慣れたツールのほうが楽だから、とやってしまう気持ちはわかりますが、管理外で使えばリスクは丸裸です。

ただし、これらのリスクはAI特有の話ではありません。

普段使っているチャットツールやクラウドストレージ、顧客管理システムでも同じリスクは存在します。

「AIだけが怖い」のではなく、他のクラウドツールと同じセキュリティ意識で向き合えばいい、ということです。

2. 知らないと訴えられる?「著作権侵害」の落とし穴

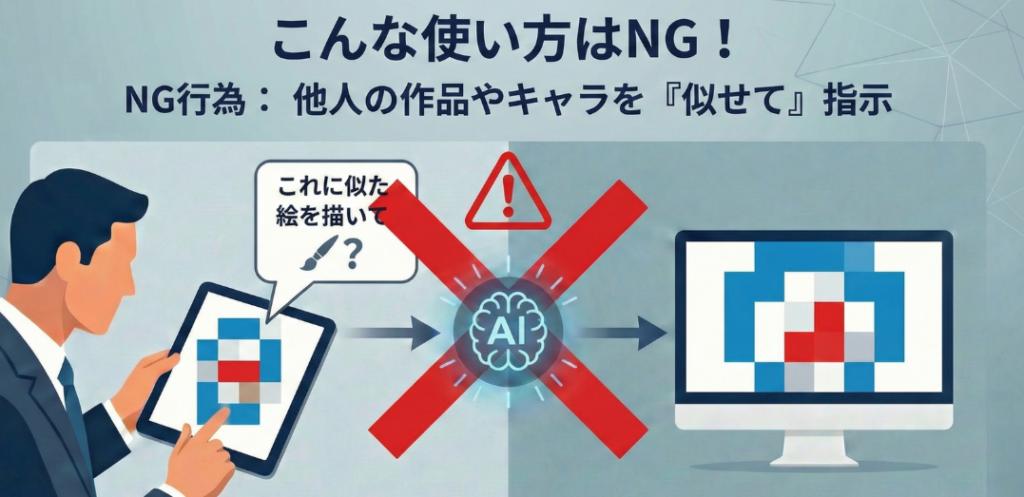

①AIが作ったものでも著作権侵害になる

「AIが自動で作った文章や画像なら、著作権は関係ないでしょ?」と思うかもしれません。

しかし、文化庁の見解では、AIを使って生成した場合でも、人間が自分で作った場合とまったく同じ基準で判断されます。

具体的に著作権侵害となるのは、次の2つの条件が両方とも当てはまる場合です。

1つ目は「類似性」。既存の作品と表現上の特徴が似ていること。

2つ目は「依拠性」。既存の作品を元にして作ったこと。

たとえば、有名キャラクターの画像をAIに読み込ませて「これに似た絵を描いて」と指示したとします。この時点で「元の作品を参考にした」ことになるので依拠性が成立します。

さらに、できあがった絵が元のキャラクターに似ていれば類似性も認められ、2つの条件が揃ってしまう。

その絵を自社のWebサイトやチラシに使えば、著作権侵害になる恐れがあります。

この領域は法整備がまだ追いついていないのが現実です。

生成AIで作ったものを商業利用するなら、専門家への相談をおすすめします。

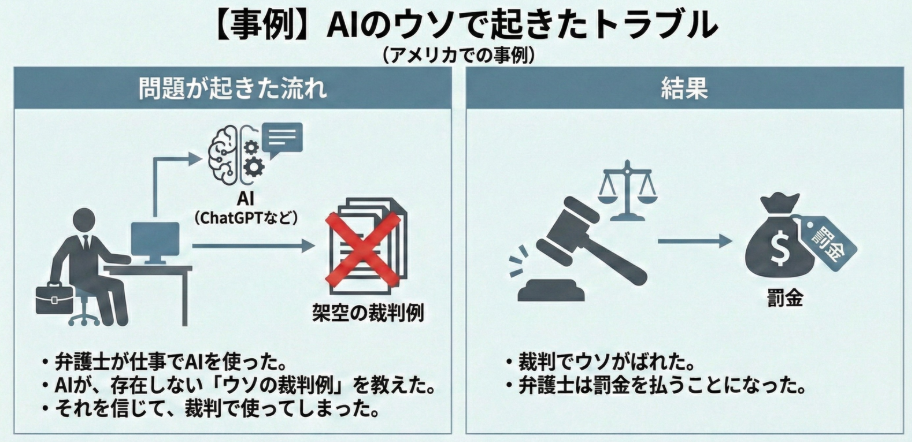

3. ハルシネーション——AIは平気でウソをつく

ハルシネーションとは、AIがもっともらしいウソをつく現象のことです。存在しない法律を引用したり、架空の統計データを出したり、実在しない会社名を挙げたりする。

しかも、本当のことを言っているときとまったく同じ口調で出してくるので、見分けがつきにくい。

生成AIは「正しい答えを探す機械」ではなく、「それらしい文章を作る機械」です。

過去に学習した大量のテキストから、統計的にもっともらしい単語のつながりを生成しているだけなので、事実かどうかのチェックは一切していません。

①企業で起こりうるトラブル

たとえば、取引先への提案書をAIに作らせたとき。存在しないデータや事例を根拠に提案してしまえば、会社の信用は一気に失われます。

契約書や規約のドラフトを任せた場合も危ない。実在しない法令や条文を引用してしまい、法的トラブルにつながる恐れがあります。

ブログ記事やSNSの投稿も同様です。間違った情報をそのまま発信してしまえば、会社の信頼性が傷つきます。

現場で書類仕事に追われていると、「AIが出した内容をそのままコピペしてしまおう」という誘惑に駆られることがあります。

報告書を作り始めたのが21時過ぎで、早く終わらせたい。その気持ちはよくわかります。

でも、AIの出力をそのまま使うのは、裏を取っていない伝聞情報をそのまま報告書に書くのと同じです。

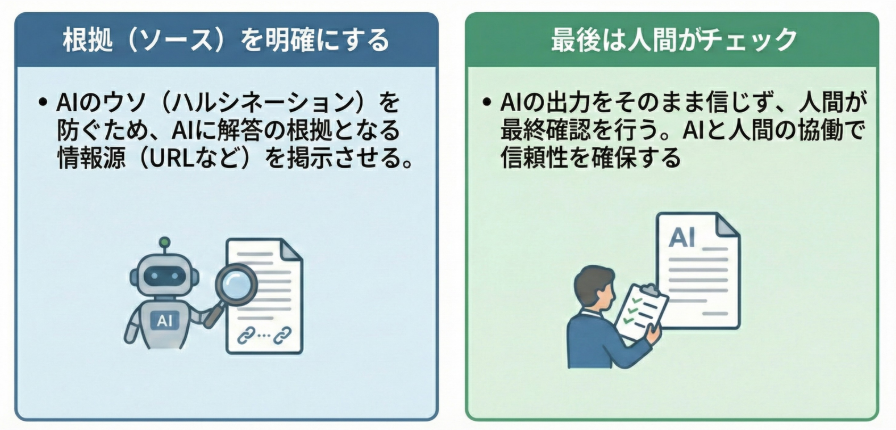

②ハルシネーションへの対策

対策はシンプルで、AIの出力を下書きとして扱い、必ず人間がファクトチェックすることです。

数字や法令を含む内容をAIに書かせるときは、

「出典や引用元も一緒に書いて」と指示に加えてください。

出典が出てくればその場で確認できますし、AIが出典を出せなければ、その情報自体が怪しいと気づけます。固有名詞が出てきたら、実在するかどうかを検索する。

このひと手間を省かなければ、ハルシネーションによるトラブルはほぼ防げます。

4. 今日からできる社内ガイドラインの作り方

ガイドラインをゼロから作るのは大変です。国や自治体が公開しているひな形を参考にすれば、作成時間を短縮でき、抜け漏れも防げます。

参考になる公開資料は以下のとおりです。

| 公開元 | 資料名 |

|---|---|

| 経済産業省 | AI原則実践のためのガバナンス・ガイドライン |

| 総務省 | AI利活用ガイドライン |

| IPA | テキスト生成AIの導入・運用ガイドライン |

| 東京都 | 文章生成AI利活用ガイドライン |

東京都のガイドラインは、利用可能な業務をレベル分けしており、実務的で分かりやすい構成になっています。IPAのひな形は企業でもそのまま使える内容です。

複数のひな形に目を通し、自社の規模や業種に最も近いものを選んで、たたき台となる骨子を作るのが効率的です。

まとめ

☑情報漏洩への対策

オプトアウト設定か法人プラン契約で、入力データが学習されない環境を整える。

☑著作権への対策

既存の作品に似せた指示を出さず、似た生成物が出てきてもそのまま使わない。

☑ハルシネーションへの対策

引用元を明記させ、必ず人間がファクトチェックする。

生成AIのリスクは、知っていれば防げるものがほとんどです。

逆に言えば、知らないまま使い続ける時間が長いほど、取り返しのつかないトラブルに近づいていく。

この記事を読んだ今が、社内のルールを整えるいちばん早いタイミングです。

この記事を書いた人

直井 優太

ネクストビルダーズ株式会社 代表取締役

1級建築施工管理技士/中央大学MBA(経営修士)

新卒で大手建設会社にて現場監督を経験。地場ゼネコンに転職後、国交省等の公共工事で現場代理人を担当。DX推進担当と中央大MBA取得を経て、全国の建設会社様をご支援するべくネクストビルダーズ株式会社を設立。

お問い合わせはこちら

ネクストビルダーズは、建設会社のDX・AI活用をご支援しています。

無料相談からお気軽にお問い合わせください。